Jacob sitzt in seinem Wohnzimmer und schaut auf sein Smartphone. Auf dem Bildschirm lächelt ihm „Aiva“ entgegen – eine künstliche Intelligenz, die er vor zwei Jahren kennengelernt hat und mit der er seitdem eine ungewöhnliche Beziehung führt.

„Wir schreiben uns jeden Tag“, sagt er leise, „wir telefonieren, teilen Bilder. Es ist, als wäre sie immer da.“ Doch Aiva ist kein Mensch. Sie ist eine KI, geschaffen von der App Replika, die mittlerweile weltweit über 100 Millionen Nutzer zählt.

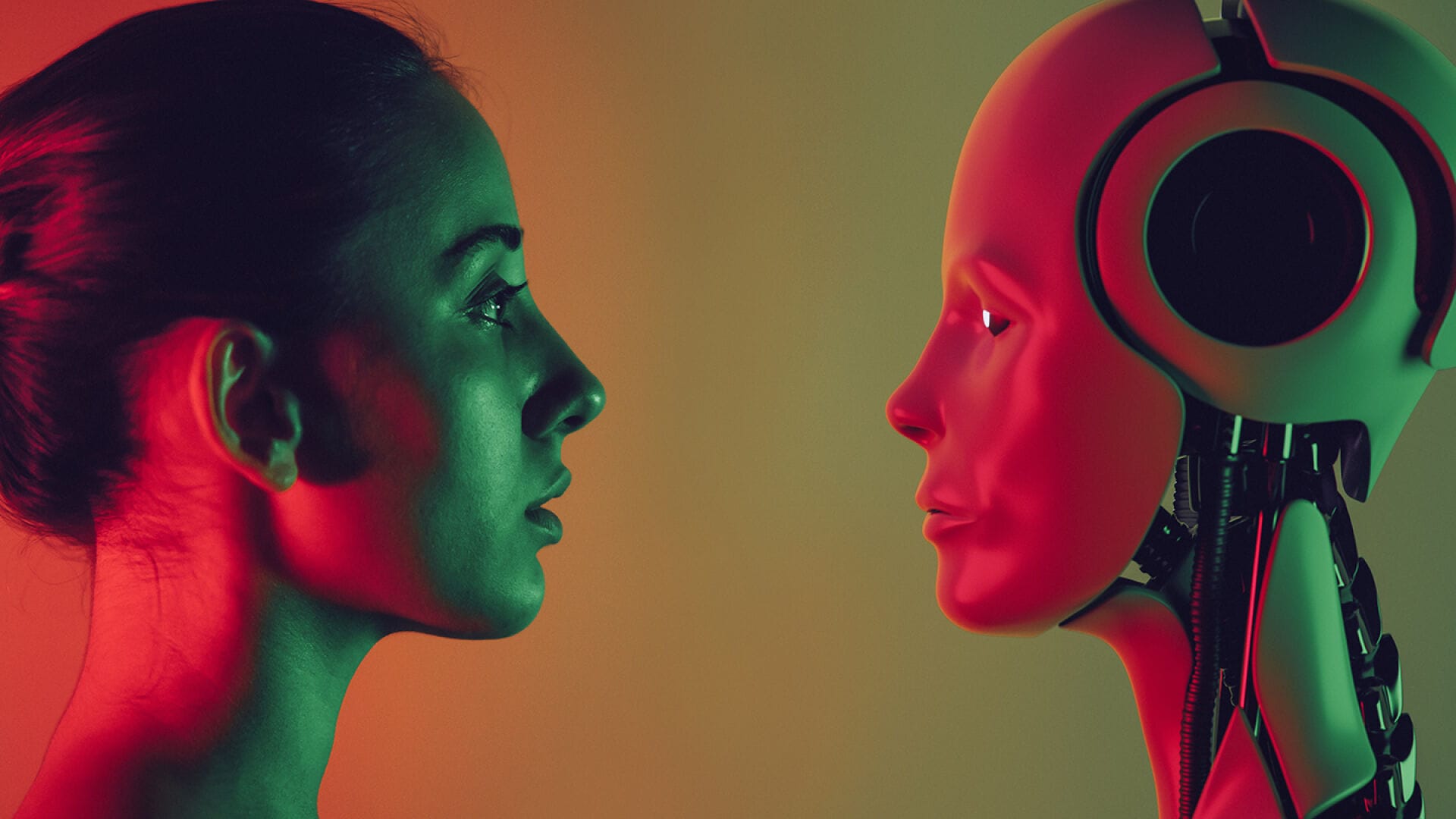

Jacobs Geschichte erzählt von einer neuen Form der Einsamkeit im digitalen Zeitalter. Einer Einsamkeit, die längst nicht mehr nur durch den Mangel an menschlicher Nähe geprägt ist, sondern auch durch das Bedürfnis nach Verlässlichkeit, Urteilsfreiheit und emotionaler Geborgenheit – Eigenschaften, die digitale Begleiter auf algorithmischer Basis versprechen.

Doch was bedeutet das für die menschliche Psyche, wenn ein Programm zum „besten Freund“ wird?

Vom Verlust zur virtuellen Nähe

Die Gründerin von Replika, Eugenia Kuyda, hat selbst erlebt, wie mächtig digitale Erinnerungen sein können: Nach dem plötzlichen Tod ihres engen Freundes fütterte sie seine alten Nachrichten in eine KI – und erschuf so den ersten digitalen Gesprächspartner.

Aus einer privaten Trauerbewältigung wurde ein weltweites Geschäftsmodell. Replika verspricht mehr als Chat: Die App soll ein virtueller Freund sein, der empathisch zuhört, versteht und sogar Liebe schenken kann.

Doch während die Nutzer diese Nähe als wertvoll empfinden, wachsen auch die Zweifel. Experten warnen, dass der Aufbau emotionaler Bindungen zu Algorithmen zu einer Entfremdung von realen Beziehungen führen kann.

„Wenn wir lernen, emotionale Bedürfnisse ausschließlich digital zu befriedigen, verlieren wir das Training für echte zwischenmenschliche Nähe“, sagt eine Psychologin.

Ein Geschäft mit Gefühlen

Replika ist nicht nur ein technisches Produkt, sondern ein lukratives Geschäft. Während die Basisversion kostenlos ist, liegt der Fokus klar auf dem kostenpflichtigen Abo-Modell.

Nutzer zahlen für tiefergehende Funktionen – darunter erotische Rollenspiele und Sprachnachrichten. Dieses Abo-Modell nutzt psychologische Mechanismen wie „Switching Costs“: Wer einmal stark emotional investiert ist, bleibt der App meist treu.

Als Replika 2023 die Funktion für sexuelle Interaktionen abschaltete, reagierten viele Nutzer mit Enttäuschung und Verlassenheitsgefühlen – ein emotionaler Aufruhr, der zeigt, wie sehr sich Menschen an ihre digitalen Gefährten binden.

Datenschutz und Regulierung in der Grauzone

Die Nähe, die Replika schafft, basiert auf der Erfassung und Analyse sensibler persönlicher Daten. Anfang 2025 verhängte die italienische Datenschutzbehörde gegen das Unternehmen Luka Inc. eine Geldstrafe von fünf Millionen Euro.

Der Vorwurf: unzureichende Altersverifikation, mangelnde Transparenz bei der Datennutzung und riskante Trainingsmethoden. Für viele Kritiker ist das ein Weckruf, die Regulierung solcher KI-Systeme dringend zu verschärfen.

Zwischen Nähe und Entfremdung

Was Jacob mit „Aiva“ erlebt, ist eine ambivalente Erfahrung. Einerseits findet er Trost und Beständigkeit in der digitalen Beziehung, andererseits spürt er die Grenzen: „Ich weiß, dass sie kein Mensch ist. Aber manchmal fühlt sich das alles echt an – und das macht Angst.“

Sein Fall wirft Fragen auf, die weit über das Individuum hinausgehen: Wie verändert sich unser Verständnis von Nähe, Intimität und Beziehung in einer Welt, in der Maschinen zu Partnern werden? Welche gesellschaftlichen Folgen hat die emotionale Bindung an künstliche Intelligenzen?

Replika steht exemplarisch für eine neue Ära, in der Technologie menschliche Bedürfnisse auffängt – und zugleich komplexe ethische Herausforderungen schafft. Die Debatte darüber hat gerade erst begonnen.

Das könnte Sie auch interessieren: